On a pu croire que les jeunes allaient tous vouloir se lancer à corps et cœur perdus dans la nouvelle révolution de l’intelligence artificielle, les LLM, ChatGPT et tous les autres.

On a pu croire que les jeunes allaient tous vouloir se lancer à corps et cœur perdus dans la nouvelle révolution de l’intelligence artificielle, les LLM, ChatGPT et tous les autres.

Eh bien, ce n’est pas si sûr, du moins pour ceux que l’on appelle la Gen Z, ceux nés à la fin des années 90 et après.

En effet, plusieurs études récentes, comme ICI, semblent démontrer un mouvement de rébellion croissant contre l’IA au sein de la génération Z.

Selon un sondage Gallup récent, seulement 18 % des Gen Z se disent « optimistes » vis-à-vis de l’IA (baisse de 9 points par rapport à 2025).

Et 44 % des jeunes travailleurs interrogés disent saboter activement la stratégie IA de leur entreprise (refus d’utiliser les outils, saisie d’informations sensibles dans les chatbots, etc.).

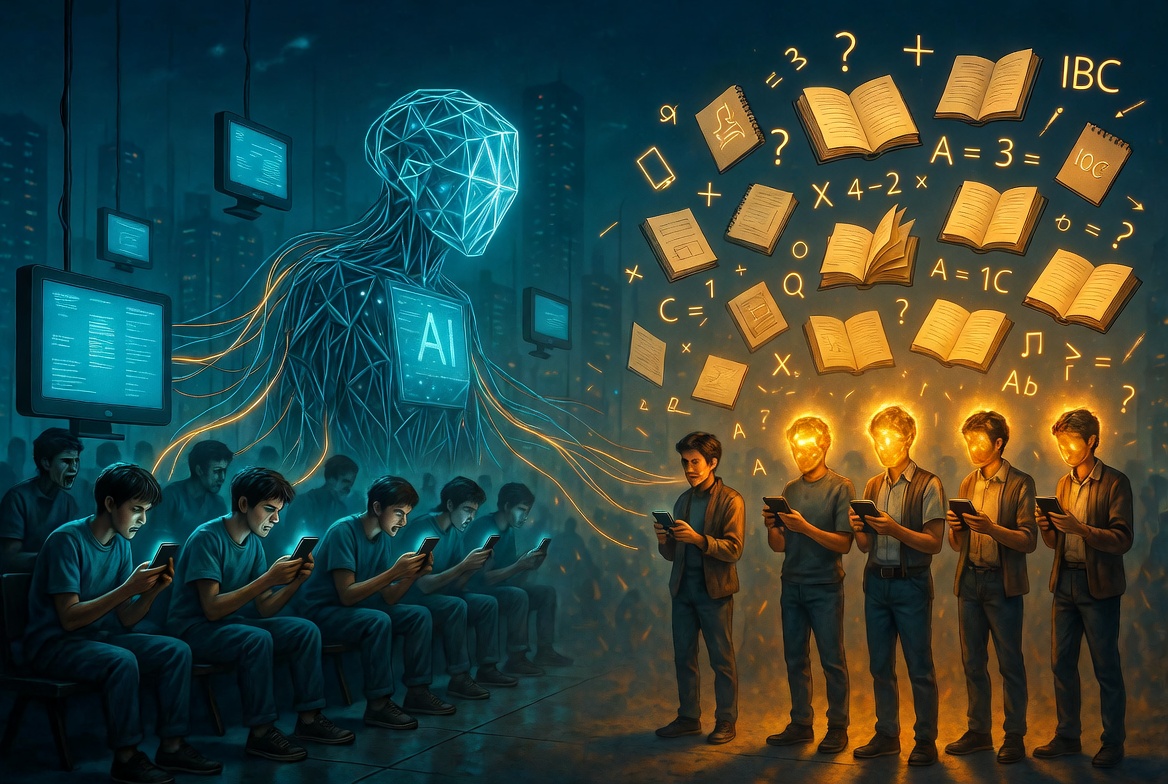

Ce que rejettent ces jeunes, ce n’est pas la technologie elle-même, mais ce qu’ils considèrent comme une menace directe sur l’emploi (et surtout le leur, qui leur fait craindre que l’IA ne va pas les aider, mais les remplacer), mais aussi l’éducation et la pensée humaine.

C’est la crainte qu’à force de trop se faire absorber par l’IA et de dépendre d’elle en tout, leur propre cerveau va en subir des conséquences graves qui les rendront inaptes.

C’est ce que l’on appelle le « cognitive offloading » : déléguer sa réflexion à l’IA.

C’est ainsi que certains étudiants et écoles revendiquent de ne pas laisser entrer trop d’IA dans l’éducation, pour préserver les lieux d’éducation comme le dernier endroit où l’on peut encore développer et protéger la pensée humaine et critique.

L’Enquête Gallup / Walton Family Foundation / GSV Ventures (avril 2026) est la référence principale. Elle porte sur plus de 1 500 jeunes de 14 à 29 ans.

- Excitation vis-à-vis de l’IA : chute de 36 % à 22 % en un an.

- Espoir: chute à 18 % (-9 points).

- Colère : hausse à 31 % (+9 points). L’utilisation reste stable (environ 50 % l’utilisent au moins une fois par semaine), mais les sentiments deviennent plus négatifs, même chez les utilisateurs quotidiens.

Ce n’est donc pas un rejet irrationnel de la technologie, mais une réaction pragmatique et en colère face à une disruption mal gérée qui touche directement leur entrée dans la vie adulte. La Gen Z est la première génération à vivre pleinement les promesses et les dégâts immédiats de l’IA générative.

C’est pourquoi les milieux éducatifs commencent à s’interroger sur les meilleures manières d’éduquer les nouvelles générations, en profitant quand c’est utile de l’IA, mais en protégeant aussi la formation des esprits.

Ces réflexions apparaissent déjà dans les universités américaines, et commencent à préoccuper aussi les milieux éducatifs en France.

Il ne s’agit plus du tout d’interdire l’utilisation de l’IA, et de la sanctionner, comme on l’a vu dans les années 2023 – 2024, mais d’adapter l’enseignement avec de nouvelles méthodes : Beaucoup d’établissements déplacent l’accent des productions finales (dissertations, rapports) vers les processus de pensée (raisonnement en classe, oraux, portfolios, drafts intermédiaires, journaux de réflexion). Les étudiants doivent souvent documenter leurs prompts IA, expliquer leur valeur ajoutée et justifier leurs choix. Cela vise à contrer le phénomène de « cognitive offloading ».

Parmi les expériences connues :

- Classes ou espaces « AI-free » : Certains professeurs déclarent leurs cours entièrement sans IA pour préserver la lecture profonde, l’écriture manuscrite, les discussions orales ou les examens papier. Exemples : cours de littérature, philosophie ou histoire où l’on insiste sur la pensée originale et la lenteur.

- Apprentissage sans IA : À Jackson State University (États-Unis), un groupe de travail dédié explore explicitement la création d’environnements d’apprentissage sans IA pour favoriser les connexions humaines, les examens oraux et les outils traditionnels. Ce n’est pas « anti-IA

- Approches hybrides : Sessions ou évaluations sans IA alternées avec des usages encadrés (ex. : brainstorming IA puis travail autonome ; quizzes sans outil après préparation avec IA). Des modèles comme « Human-AI-Human » ou des périodes « retrieval practice » (rappel sans aide) sont testés.

Avec l’IA, les enseignants ont compris que les productions finales (dissertations, rapports finis) sont devenues trop faciles à générer ou améliorer avec l’IA. Les établissements se concentrent donc sur le parcours : comment l’étudiant a raisonné, itéré, critiqué et intégré (ou non) l’IA. Cela rend visible l’engagement cognitif réel et décourage la passivité.

On va ainsi demander, par exemple, aux étudiants de donner la liste des prompts qu’ils ont utilisés, et comment.

Autre évolution : Forte augmentation des examens oraux (« oral defenses ») et présentations où l’étudiant doit expliquer son travail en direct.

En France, Sciences Po a récemment structuré sa doctrine IA :

- Les étudiants doivent documenter leur usage de l’IA : détailler les étapes, outils utilisés et adopter une démarche réflexive.

- Évolution des modalités d’évaluation : formats classiques (devoirs sur table, oraux) + formats hybrides (analyses comparatives IA/humain, travaux augmentés avec réflexion critique).

- L’évaluation valorise la problématisation, l’argumentation et la pensée personnelle. Les enseignants sont accompagnés pour tester de nouveaux formats (Institut des compétences et de l’innovation).

Après une étape d’euphories ou d’interdictions, on est peut-être enfin en train de passer à une étape d’utilisation de l’IA…intelligente.

En formant ainsi les jeunes qui vont entrer, ou qui viennent d’entrer, dans le monde du travail, et en étant attentifs à leurs peur de devenir des idiots sur pattes, ceux-ci seront peut-être ceux avec des cerveaux qui pensent, au milieu de certains de leurs seniors, et de la génération Y qui les a précédés, qui auront perdu le sens critique en s’abrutissant de ChatGPT et autres LLM sans parachute. Ceux-là aussi vont devoir se (re) former à la pensée humaine, peut-être.

A suivre.

Laisser un commentaire